Spring AOP 自定义注解不生效?多数据源切换场景下的排查与解决全解析 在实际开发中,多数据源切换是常见需求,比如主从分离、业务库与日志库分离等。为了简化数据源切换逻辑,我们通常会使用 Spring AOP 结合自定义注解实现“注解标识+切面拦截”的无感切换。但在开发过程中,很容易遇到自定义注解不生效的问题——注解标注在方法上,切面逻辑却始终不执行,数据源切换失败。本文将从问题发现、注解定义、异常排查、原理解析、Demo 实现到最终解决,完整还原整个排查过程,帮你避开 AOP 自定义注解的常见坑。

一、问题发现:多数据源切换失效,注解“形同虚设” 最近在开发一个多数据源项目,核心需求是:通过自定义注解 @DataSource 标注业务方法,指定方法需要访问的数据源(主库/从库),切面拦截该注解,动态切换数据源。

初期开发思路很清晰:定义注解 → 编写切面类,通过 @Around 拦截注解标注的方法 → 切面中获取注解指定的数据源名称,切换数据源 → 方法执行完成后恢复默认数据源。

但当代码开发完成,启动项目测试时,问题出现了:无论在方法上标注 @DataSource("slave") 还是 @DataSource("master"),方法始终访问的是默认主库,数据源切换逻辑完全不生效。通过日志排查发现,切面类中的拦截方法从未被执行,自定义注解就像“形同虚设”,没有起到任何作用。

带着这个问题,我们从“注解定义”开始,一步步排查不生效的原因。

二、自定义注解与切面编写:看似正确,实则藏坑 先贴出最初编写的自定义注解和切面代码,大家可以先试着找找问题所在。

2.1 自定义数据源注解 @DataSource 1 2 3 4 5 6 7 8 @Target(ElementType.METHOD) @Retention(RetentionPolicy.RUNTIME) public @interface DataSource { String value () default "master" ; }

2.2 编写 AOP 切面类,拦截注解 1 2 3 4 5 6 7 8 9 10 11 12 13 14 15 16 17 18 19 20 21 22 23 24 public class DataSourceAspect { @Autowired private DataSourceContextHolder dataSourceContextHolder; @Around("@annotation(dataSource)") public Object around (ProceedingJoinPoint joinPoint, DataSource dataSource) throws Throwable { try { String dsName = dataSource.value(); dataSourceContextHolder.setDataSource(dsName); return joinPoint.proceed(); } finally { dataSourceContextHolder.clearDataSource(); } } }

2.3 数据源配置与上下文 同时配置了主从数据源(master/slave),实现了 DataSourceContextHolder 用于ThreadLocal存储当前线程的数据源名称,并重写了 AbstractRoutingDataSource 实现动态数据源路由,这部分代码暂时无问题(后续会贴出完整Demo)。

从代码上看,注解定义、切面拦截逻辑似乎都没问题,但为什么切面不执行、注解不生效?

三、注解不生效的核心原因:Spring AOP 生效的3个关键条件 要解决自定义注解不生效的问题,首先要搞懂 Spring AOP 自定义注解生效的核心原理——Spring AOP 基于动态代理实现,要让切面拦截注解,必须满足3个关键条件,缺一不可,而我们的问题,正是忽略了其中1个核心条件。

3.1 核心原理:Spring AOP 的动态代理机制 Spring AOP 有两种动态代理方式:JDK 动态代理(基于接口)和 CGLIB 动态代理(基于子类)。无论哪种方式,其核心逻辑都是:对被代理的Bean生成代理对象,当调用代理对象的方法时,触发切面逻辑,再执行目标方法 。

而自定义注解要被切面拦截,本质是:代理对象的方法被调用时,Spring 能识别到方法上的注解,并触发对应的切面逻辑。

3.2 注解不生效的3个常见原因(对应3个关键条件) 结合我们的场景,逐一排查后,发现问题出在第3个条件上:

注解未被 Spring 扫描到 :如果注解所在的包、切面类所在的包,未被 Spring 的 @ComponentScan 扫描到,Spring 无法识别注解和切面,自然不会生效。(我们的项目配置了包扫描,此条件满足)

切面类未被 Spring 管理 :切面类必须添加 @Aspect 注解(标识为切面),且添加 @Component 或其他注解(让 Spring 实例化该类),否则 Spring 不会将其作为切面处理。(我们的切面类缺少 @Aspect 和 @Component,这是第一个小问题,但不是核心)

被注解标注的方法,必须是 Spring 代理对象的方法 :这是最容易被忽略的核心条件!如果方法是 private 修饰、或者是静态方法、或者是内部方法调用(this.方法名()),Spring 无法生成代理,切面自然无法拦截。(我们的问题核心:业务方法是被同一个类中的其他方法调用,属于内部方法调用,未走代理对象)

3.3 我们的核心问题:内部方法调用,跳过了 Spring 代理 举个例子,我们的业务代码如下:

1 2 3 4 5 6 7 8 9 10 11 12 13 14 15 16 17 @Service public class UserService { public void methodA () { methodB(); } @DataSource("slave") public void methodB () { System.out.println("访问从库,查询用户数据" ); } }

当外部调用 userService.methodA() 时,methodA 内部通过 this.methodB() 调用标注了注解的 methodB。这里的this 是 UserService 的原始对象(目标对象),不是 Spring 生成的代理对象。而 Spring AOP 的切面拦截,只对代理对象的方法调用生效,因此切面无法拦截 methodB,注解自然不生效。

这就是我们遇到的核心问题——内部方法调用,跳过了 Spring 代理,导致切面拦截失败,注解不生效 。

四、完整 Demo 实现:从问题复现到解决 下面我们通过完整的 Demo 复现问题,并逐步解决,确保自定义注解生效,实现多数据源正常切换。

4.1 环境准备 技术栈:Spring Boot 2.7.x + Spring AOP + MyBatis + MySQL(主从库)

核心依赖(pom.xml 关键依赖):

1 2 3 4 5 6 7 8 9 10 11 12 13 14 15 16 17 18 19 20 21 22 <dependency > <groupId > org.springframework.boot</groupId > <artifactId > spring-boot-starter-web</artifactId > </dependency > <dependency > <groupId > org.springframework.boot</groupId > <artifactId > spring-boot-starter-aop</artifactId > </dependency > <dependency > <groupId > org.mybatis.spring.boot</groupId > <artifactId > mybatis-spring-boot-starter</artifactId > <version > 2.2.2</version > </dependency > <dependency > <groupId > mysql</groupId > <artifactId > mysql-connector-java</artifactId > <scope > runtime</scope > </dependency >

4.2 步骤1:完善自定义注解 @DataSource 1 2 3 4 5 6 7 8 9 10 11 12 13 import java.lang.annotation.*;@Target({ElementType.METHOD, ElementType.TYPE}) @Retention(RetentionPolicy.RUNTIME) @Documented public @interface DataSource { String value () default "master" ; }

4.3 步骤2:实现数据源上下文(ThreadLocal 存储当前数据源) 1 2 3 4 5 6 7 8 9 10 11 12 13 14 15 16 17 18 19 20 21 22 23 24 public class DataSourceContextHolder { private static final ThreadLocal<String> CONTEXT_HOLDER = new ThreadLocal <>(); public static void setDataSource (String dataSourceName) { CONTEXT_HOLDER.set(dataSourceName); } public static String getDataSource () { return CONTEXT_HOLDER.get() == null ? "master" : CONTEXT_HOLDER.get(); } public static void clearDataSource () { CONTEXT_HOLDER.remove(); } }

4.4 步骤3:实现动态数据源路由(重写 AbstractRoutingDataSource) 1 2 3 4 5 6 7 8 9 10 11 12 13 14 import org.springframework.jdbc.datasource.lookup.AbstractRoutingDataSource;public class DynamicDataSource extends AbstractRoutingDataSource { @Override protected Object determineCurrentLookupKey () { return DataSourceContextHolder.getDataSource(); } }

4.5 步骤4:完善 AOP 切面类(关键:添加 @Aspect 和 @Component) 1 2 3 4 5 6 7 8 9 10 11 12 13 14 15 16 17 18 19 20 21 22 23 24 25 26 27 28 29 30 31 32 33 34 35 36 37 import org.aspectj.lang.ProceedingJoinPoint;import org.aspectj.lang.annotation.Around;import org.aspectj.lang.annotation.Aspect;import org.aspectj.lang.annotation.Pointcut;import org.springframework.beans.factory.annotation.Autowired;import org.springframework.stereotype.Component;@Aspect @Component public class DataSourceAspect { @Pointcut("@annotation(com.example.dynamicdatasource.annotation.DataSource)") public void dataSourcePointCut () {} @Around("dataSourcePointCut() && @annotation(dataSource)") public Object around (ProceedingJoinPoint joinPoint, DataSource dataSource) throws Throwable { try { String dsName = dataSource.value(); DataSourceContextHolder.setDataSource(dsName); System.out.println("数据源切换成功,当前数据源:" + dsName); return joinPoint.proceed(); } finally { DataSourceContextHolder.clearDataSource(); System.out.println("数据源已恢复默认(master)" ); } } }

4.6 步骤5:配置多数据源(application.yml) 1 2 3 4 5 6 7 8 9 10 11 12 13 14 15 16 17 18 19 20 21 22 23 spring: datasource: master: driver-class-name: com.mysql.cj.jdbc.Driver url: jdbc:mysql://localhost:3306/master_db?useUnicode=true&characterEncoding=utf-8&serverTimezone=UTC username: root password: 123456 slave: driver-class-name: com.mysql.cj.jdbc.Driver url: jdbc:mysql://localhost:3306/slave_db?useUnicode=true&characterEncoding=utf-8&serverTimezone=UTC username: root password: 123456 dynamic: primary: master strict: false mybatis: mapper-locations: classpath:mapper/**/*.xml type-aliases-package: com.example.dynamicdatasource.entity

4.7 步骤6:配置数据源 Bean(关键:注入动态数据源) 1 2 3 4 5 6 7 8 9 10 11 12 13 14 15 16 17 18 19 20 21 22 23 24 25 26 27 28 29 30 31 32 33 34 35 36 37 38 39 40 41 42 43 44 45 46 import org.springframework.boot.context.properties.ConfigurationProperties;import org.springframework.boot.jdbc.DataSourceBuilder;import org.springframework.context.annotation.Bean;import org.springframework.context.annotation.Configuration;import org.springframework.context.annotation.Primary;import javax.sql.DataSource;import java.util.HashMap;import java.util.Map;@Configuration public class DataSourceConfig { @Bean(name = "masterDataSource") @ConfigurationProperties(prefix = "spring.datasource.master") public DataSource masterDataSource () { return DataSourceBuilder.create().build(); } @Bean(name = "slaveDataSource") @ConfigurationProperties(prefix = "spring.datasource.slave") public DataSource slaveDataSource () { return DataSourceBuilder.create().build(); } @Primary @Bean(name = "dynamicDataSource") public DataSource dynamicDataSource () { DynamicDataSource dynamicDataSource = new DynamicDataSource (); dynamicDataSource.setDefaultTargetDataSource(masterDataSource()); Map<Object, Object> dataSourceMap = new HashMap <>(); dataSourceMap.put("master" , masterDataSource()); dataSourceMap.put("slave" , slaveDataSource()); dynamicDataSource.setTargetDataSources(dataSourceMap); return dynamicDataSource; } }

4.8 步骤7:解决核心问题——内部方法调用不生效 针对“内部方法调用跳过代理”的问题,有两种常用解决方案,根据实际场景选择:

方案1:避免内部方法调用,直接外部调用标注注解的方法 修改业务代码,将标注 @DataSource 的方法,改为对外提供接口,避免内部调用:

1 2 3 4 5 6 7 8 9 10 11 12 13 14 15 16 @Service public class UserService { public void methodA () { SpringContextUtil.getBean(UserService.class).methodB(); } @DataSource("slave") public void methodB () { System.out.println("访问从库,查询用户数据" ); } }

其中 SpringContextUtil 是Spring上下文工具类,用于获取代理对象,实现如下:

1 2 3 4 5 6 7 8 9 10 11 12 13 14 15 16 17 18 19 20 import org.springframework.context.ApplicationContext;import org.springframework.context.ApplicationContextAware;import org.springframework.stereotype.Component;@Component public class SpringContextUtil implements ApplicationContextAware { private static ApplicationContext applicationContext; @Override public void setApplicationContext (ApplicationContext applicationContext) { SpringContextUtil.applicationContext = applicationContext; } public static <T> T getBean (Class<T> clazz) { return applicationContext.getBean(clazz); } }

方案2:开启 CGLIB 代理,并通过 AopContext 获取当前代理对象

开启 CGLIB 代理(Spring Boot 2.x 默认开启,可在 application.yml 中显式配置):

1 2 3 4 5 spring: aop: proxy-target-class: true auto: true

业务方法中通过 AopContext.currentProxy() 获取当前代理对象,调用标注注解的方法:

1 2 3 4 5 6 7 8 9 10 11 12 13 14 15 @Service public class UserService { public void methodA () { UserService proxy = (UserService) AopContext.currentProxy(); proxy.methodB(); } @DataSource("slave") public void methodB () { System.out.println("访问从库,查询用户数据" ); } }

注意:使用 AopContext.currentProxy() 需要在启动类添加 @EnableAspectJAutoProxy(exposeProxy = true),暴露代理对象:

1 2 3 4 5 6 7 8 9 10 11 12 import org.springframework.boot.SpringApplication;import org.springframework.boot.autoconfigure.SpringBootApplication;import org.springframework.context.annotation.EnableAspectJAutoProxy;@SpringBootApplication @EnableAspectJAutoProxy(exposeProxy = true) public class DynamicDatasourceApplication { public static void main (String[] args) { SpringApplication.run(DynamicDatasourceApplication.class, args); } }

方案3:重新实现Bean的方式(彻底规避内部调用问题) 核心思路:将标注注解的方法,拆分到新的Bean中,通过依赖注入的方式调用,彻底避免同一个类中的内部方法调用,确保走Spring代理对象,从而让切面正常拦截。

新建业务Bean,封装标注注解的方法(单独抽离,避免内部调用):

1 2 3 4 5 6 7 8 9 @Service public class UserDataSourceService { @DataSource("slave") public void methodB () { System.out.println("访问从库,查询用户数据" ); } }

原业务类中注入新Bean,通过注入的代理对象调用方法,避免内部调用:

1 2 3 4 5 6 7 8 9 10 11 12 @Service public class UserService { @Autowired private UserDataSourceService userDataSourceService; public void methodA () { userDataSourceService.methodB(); } }

优势:无需依赖Spring上下文工具类,也无需配置暴露代理对象,通过Bean拆分的方式,从根源上避免内部调用问题,代码更规范、可维护性更强;

适用场景:业务逻辑可拆分、希望代码结构更清晰,不想依赖AopContext或上下文工具类的场景。

1 2 3 4 5 6 7 8 9 10 11 12 import org.springframework.boot.SpringApplication;import org.springframework.boot.autoconfigure.SpringBootApplication;import org.springframework.context.annotation.EnableAspectJAutoProxy;@SpringBootApplication @EnableAspectJAutoProxy(exposeProxy = true) public class DynamicDatasourceApplication { public static void main (String[] args) { SpringApplication.run(DynamicDatasourceApplication.class, args); } }

4.9 测试验证:注解生效,数据源正常切换 编写测试接口,调用 userService.methodA(),查看日志:

1 2 3 4 5 6 7 8 9 10 11 12 13 14 @RestController @RequestMapping("/user") public class UserController { @Autowired private UserService userService; @GetMapping("/test") public String testDataSource () { userService.methodA(); return "success" ; } }

启动项目,访问接口 http://localhost:8080/user/test,控制台输出如下,说明注解生效,数据源切换成功:

1 2 3 4 数据源切换成功,当前数据源:slave 访问从库,查询用户数据 数据源已恢复默认(master)

五、问题总结与常见避坑指南 通过以上排查和实践,我们成功解决了 Spring AOP 自定义注解不生效的问题,同时也梳理出了开发中容易踩的坑,总结如下:

5.1 本次问题的核心原因

切面类缺少 @Aspect 和 @Component 注解,导致 Spring 未识别切面;

核心原因:业务方法存在内部调用(this.方法名()),跳过了 Spring 代理对象,切面无法拦截,注解不生效。

5.2 Spring AOP 自定义注解生效的3个必满足条件

注解必须添加 @Retention(RetentionPolicy.RUNTIME),确保运行时能通过反射获取;

切面类必须添加 @Aspect(标识切面)和 @Component(交给 Spring 管理);

被注解标注的方法,必须是 Spring 代理对象的方法(避免内部调用、private 修饰、静态方法)。

5.3 常见避坑点

避坑1:切面类忘记加 @Component,Spring 无法实例化切面,拦截逻辑不执行;

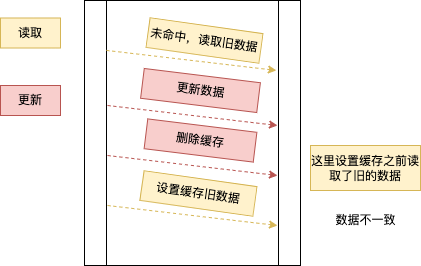

避坑2:内部方法调用(this.方法),跳过代理,注解不生效(解决方案:用代理对象调用,或避免内部调用);

避坑3:注解的@Target 范围错误,比如想标注方法却写成ElementType.TYPE(类);

避坑4:动态数据源配置时,未将动态数据源设为 @Primary,导致 Spring 无法使用自定义数据源;

避坑5:方法执行完成后,未清除 ThreadLocal 中的数据源名称,导致线程复用时分不清数据源。

5.4 最终感悟 Spring AOP 自定义注解不生效,看似是“注解没起作用”,本质是对 Spring 动态代理机制理解不透彻。很多时候,问题不是出在注解或切面的逻辑上,而是出在“方法调用是否走代理”这个细节上。

对于后端开发者来说,多数据源切换是高频需求,掌握 AOP 自定义注解的正确使用方式,不仅能解决当下的问题,更能理解 Spring 代理的核心逻辑,避开类似的坑。希望本文的排查过程和解决方案,能帮你快速解决 Spring AOP 自定义注解不生效的问题,提升开发效率。